Stasera ho zero voglia di scrivere per millegiga motivi. Quindi lascerò fare il 99% del lavoro alla macchina. O almeno questo era il mio intento iniziale. Sì, perché alla fine lo sappiamo tutti che non è ancora arrivato il momento in cui sia davvero possibile. Di certo non con l’approccio dello stereotipo del bambino scassacazzo. Ma sì, quello che ti massacra di domande tipo “quando arriviamo?” o ripete “perché?” ad ogni risposta. Se ci pensate…quello é proprio il prompting! Zero interesse per il contesto. Zero sensibilità rispetto a che il destinatario della domanda abbia realmente la risposta.

Tempo fa (nemmen troppo) mi sbagliavo. Ho definito la macchina, la recente capacità di AI, come un bambino della scuola materna che deve ancora imparare tantissime cose. Sì, lo è! Ma fa molto peggio l’essere umano che si preoccupa unicamente di formulare la domanda corretta per ottenere ciò che gli serve. Nessuna responsabilità rispetto a ciò che realmente può sapere papà ChatGPT o mamma Copilot. Si tratta solo di incalzarli con domande sempre più precise e inquisitorie pur di ottenere il risultato migliore. Oddio…migliore in assoluto no, relativamente ad un seppure enorme patrimonio informativo general-generico, forse sì. Come scrisse il maestro “ne ho un tantino pieni i cabasisi!”. Ma è possibile che proprio nel momento storico più dirimenti degli ultimi vent’anni rispetto a questa chiamata alle armi globale e globalista, ci si ritrovi invasi dai seguaci di Mastro Cazzaro? Proprio loro! Quelli che nei primi anni ’90 tagliavano la prima variante del circuito di Monza a GP (il primo e inarrivabile prodotto di Geoff Crammond) o che non consideravano valido un goal se non avevano avuto il tempo di mettersi in porta nel Subbuteo.

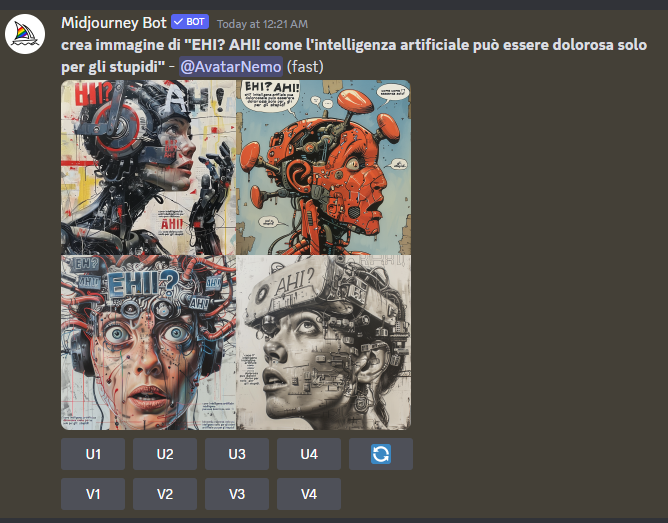

Non mi dilungo ulteriormente e ora lascio davvero la parola alle macchine. Le ho usate per produrre contenuti di diversa natura. Le immagini sono ampiamente rivedibili ma mi piacciono perché provocatorie. I testi direi invece che andrebbero assaporati nella loro spontanea interezza.

Per chi volesse un sottofondo, mi sentirei di consigliare questo. Ma poi fate anche un po’ il cazzo che volete! L’ho anche messo con autoplay, giusto per essere molesto come solo io so essere. Stop it if you prefer so!

ChatGPT

La distinzione tra Reti di Generazione di Risposte (RAG, dall’inglese “Retrieval-Augmented Generation”) come strumenti aziendali e ChatGPT non è necessariamente assoluta o definitiva; piuttosto, riguarda le loro applicazioni ottimali, capacità e il modo in cui vengono tipicamente implementati.

RAG come Strumenti Aziendali

Le RAG combinano la capacità di recupero delle informazioni (retrieval) con la generazione di testo basata sull’intelligenza artificiale. Questo significa che possono cercare informazioni specifiche da un vasto database o da un insieme di documenti per fornire risposte più accurate e informate. Per le aziende, questo ha diverse applicazioni pratiche:

Supporto decisionale basato su dati: Le RAG possono aiutare i dirigenti aziendali e gli analisti a prendere decisioni informate estraendo e sintetizzando informazioni rilevanti da grandi volumi di dati.

Customer service migliorato: Utilizzando le RAG, le aziende possono offrire risposte personalizzate e altamente informative ai clienti, attingendo a un’ampia base di conoscenze.

Efficienza operativa: Le RAG possono automatizzare la raccolta e l’analisi di informazioni per vari dipartimenti, riducendo il carico di lavoro manuale e migliorando l’accuratezza delle informazioni.

ChatGPT

ChatGPT, d’altra parte, è un modello di linguaggio basato su GPT (Generative Pre-trained Transformer) che eccelle nella generazione di testo naturale. Sebbene possa essere utilizzato in contesti aziendali per svariati scopi come il supporto clienti, la generazione di contenuti e l’automazione di processi, ha alcune limitazioni rispetto alle RAG per quanto riguarda la personalizzazione e l’accesso diretto a database aziendali specifici:

Generalista per natura: ChatGPT è addestrato su un vasto set di dati di internet, il che lo rende estremamente versatile ma meno specializzato in specifici ambiti aziendali rispetto alle RAG che possono attingere a fonti di dati mirate.

Aggiornamenti e precisione dei dati: Mentre le RAG possono essere aggiornate in tempo reale attingendo da fonti di dati aggiornate, ChatGPT può essere limitato dalle informazioni su cui è stato addestrato, che potrebbero non essere aggiornate o specifiche per le esigenze aziendali.

In sintesi, mentre le RAG offrono vantaggi specifici per applicazioni aziendali grazie alla loro capacità di integrare la ricerca di informazioni specifiche e la generazione di risposte, ChatGPT è uno strumento più generalista che eccelle nella generazione di testo coerente e naturale. Le scelte tra questi strumenti dipendono dagli obiettivi specifici, dalle esigenze di informazione e dalle strategie di implementazione tecnologica delle aziende.

Già qui cone la risposta di ChatGPT di OPENAI…potrei fermarmi e invece no!

Ma vi giuro che ho chiesto solo di creare un’immagine come ho fatto su DALL-E e su Midjourney, eppure…l’engine sarebbe poi anche lo stesso! (dettagli a piè pagina!).

COPILOT

Ciao, sono Copilot, il tuo assistente virtuale.

Le RAG sono strumenti aziendali perché permettono di integrare modelli di linguaggio avanzati con le proprie basi di dati e conoscenze specifiche, portando a un’efficienza e a un’efficacia senza precedenti nelle interazioni con i clienti e nell’automazione dei processi1. Le RAG sono in grado di rispondere a domande complesse e specifiche, basandosi su fonti affidabili e pertinenti.

ChatGPT, invece, non è uno strumento aziendale perché viola le norme sul trattamento dei dati personali, come stabilito dal Garante della privacy italiano. ChatGPT trasferisce i dati verso gli Stati Uniti senza un presupposto giustificativo, non rispetta l’età minima per il consenso al trattamento e non fornisce una base giuridica adeguata per il trattamento stesso. Inoltre, ChatGPT non è in grado di garantire l’accuratezza e la sicurezza dei dati online, essendo basato su una quantità enorme di articoli, siti web e post sui social media raccolti da Internet, senza una verifica della qualità e della veridicità delle informazioni.

Questa risposta mi ha ammazzato! Come se Copilot facesse diversamente e magari non usasse i modelli di OPENAI per i quali Micorsoft ha pagato billions negli ultimi anni!

Vi condivido infatti lo stupidissimo prompt iniziale rispetto alle immagini che avete trovato qui sopra: “RAG (Retrieval-Augmented Generation) based on vector database, AI embeddings before calling LLM model, data and intellectual property are safe in that architecture”.

Come avete avuto modo di vedere le interpretazioni delle macchine sono state diverse ma il fattore comune è l’antropocentrismo e ciò non è affatto posisivo. Men che meno approcci suprermatisti della macchina sull’essere umano. Qui forse potrei azzardare che il bambino pirla del prompting non sta propriamente avendo effetti positivi sull’interpretazione della macchina stessa ma mi trattengo.

Vi lascio con un pensiero positivo, quindi non nativamente mio, ovvero che i danni che stanno producendo tutti quest’insipienti nuovi esperti tecnologici rispetto alla vera costruzione di AI, non sono che transitori. Il no-code ed il low-code sono meravigliose creazioni. Sono stati infatti generati da chi invece sviluppa eccome e non lo fa usando la Gen-AI. No, parliamo del vecchio metodo COLEMAN. “Con le mani” che consumano keyboard e ci regalano un futuro migliore. Nonostante tutto e nonostante tutti!

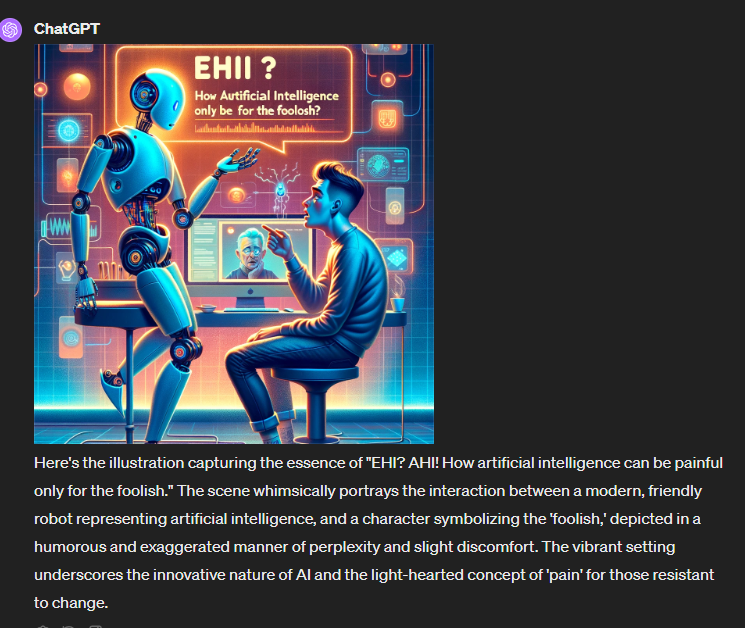

Poi la macchina mi dice “EHI? AHI! come l’intelligenza artificiale può essere dolorosa solo per gli stupidi è un titolo provocatorio e ironico che potrebbe essere usato per un libro, un articolo, un podcast o un altro tipo di contenuto che tratta del rapporto tra l’intelligenza artificiale e gli esseri umani. Il titolo suggerisce che l’intelligenza artificiale può essere una risorsa o una minaccia a seconda di come viene usata e compresa, e che solo gli stupidi possono subire le conseguenze negative di una cattiva gestione o di una mancanza di consapevolezza. Il titolo usa due esclamazioni, EHI? e AHI!, per attirare l’attenzione e creare un contrasto tra la curiosità e il dolore. Il titolo usa anche il termine stupidi per provocare una reazione emotiva e stimolare il dibattito.”

History in the making…pensavo di chiudere ma le macchine hanno iniziato a svalvolare. Il prompt è “EHI? AHI! come l’intelligenza artificiale può essere dolorosa solo per gli stupidi“. Copilot almeno è andato in bomba! Peggio gli altri!

Allitterando un altro grande maestro – in questo caso del cinema – “quando l’uomo che prompta incontra l’uomo che scrive nel database vettoriale, l’uomo che prompta è un uomo morto!”.

Atque etiam hodie cras loquemur!